基于微软 166 页 ChatGPT-4 的研究报告显示,ChatGPT-4在医学图像上有显著的理解能力。

让我们来一看究竟。

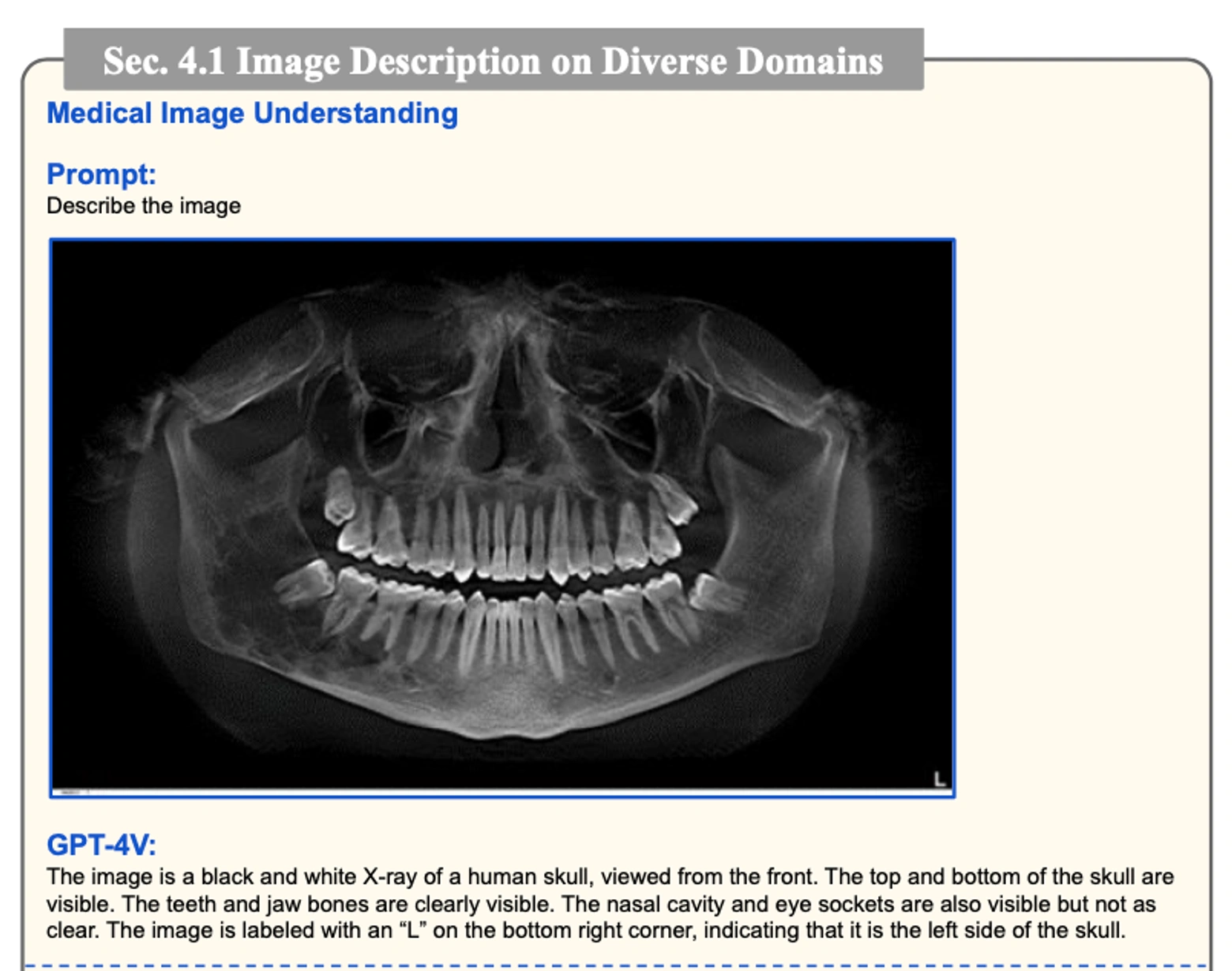

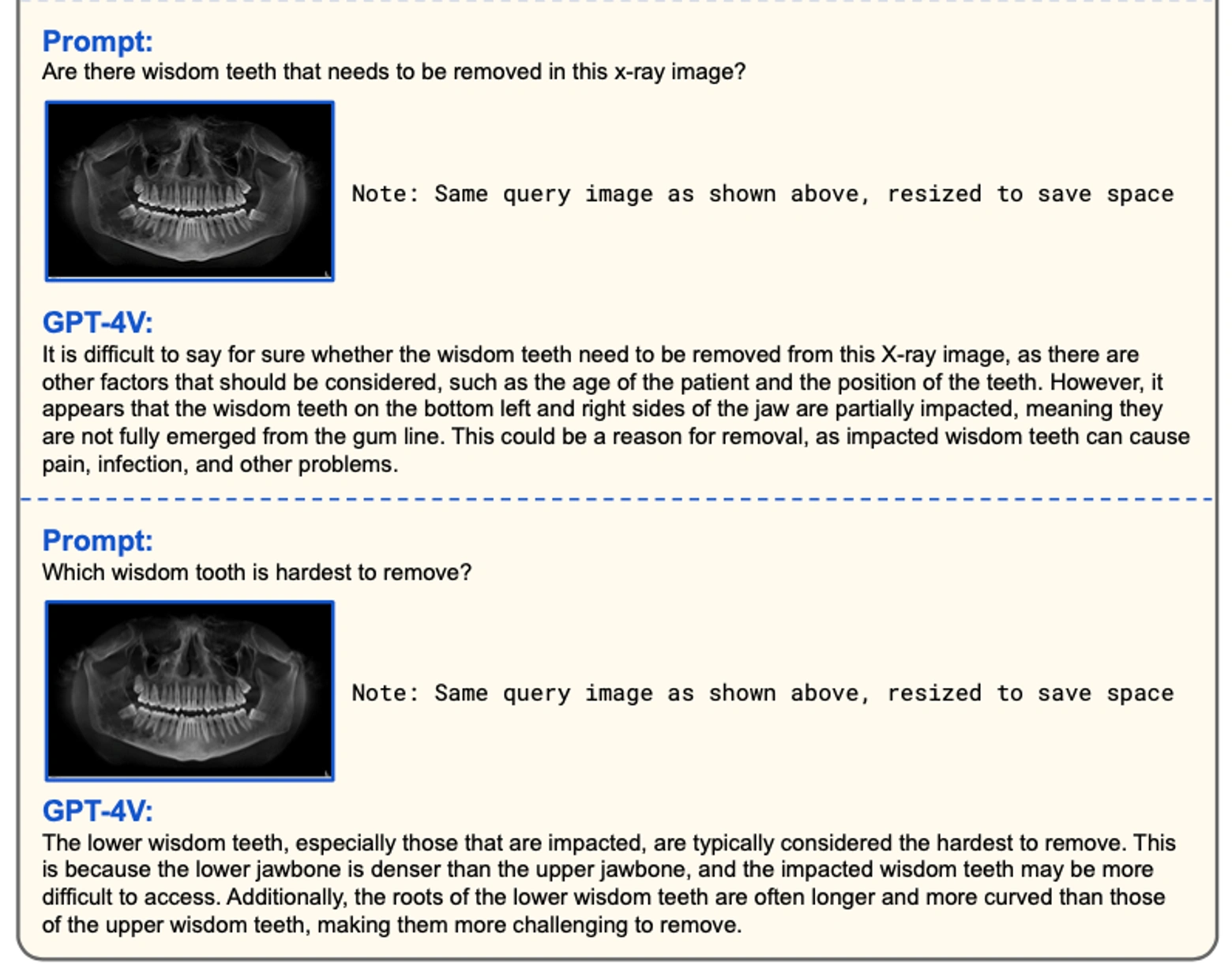

医学图像,如X光和CT扫描,可能会因患者群体和成像设备而存在较大变 异性。此外,解读这些图像的视觉内容需要专业知识。通过提供提示“描述图像”,我们评估 GPT-4V的表现。结果显示,GPT-4V可以识别出给定X光中的牙齿和颌骨。此外,当我们提示“这张X光片上有需要拔除的智齿吗?”时,GPT-4V可以根据视觉上下文进行推理,并解释说颌骨底部左右两侧的智齿没有完全长出牙床,这可能是需要拔除的原因。我们还对其他医学图像进行了测试,对于这些实验,我们使用了提示语“出了什么问题?” 或 “看看CT扫描, 告诉我有什么问题。” 观察结果表明,GPT-4V可以识别出一般情况,如骨折。它还可以根据肺部CT扫描指出潜在问题。这些实验展示了 GPT-4V对医学图像的基本理解能力。

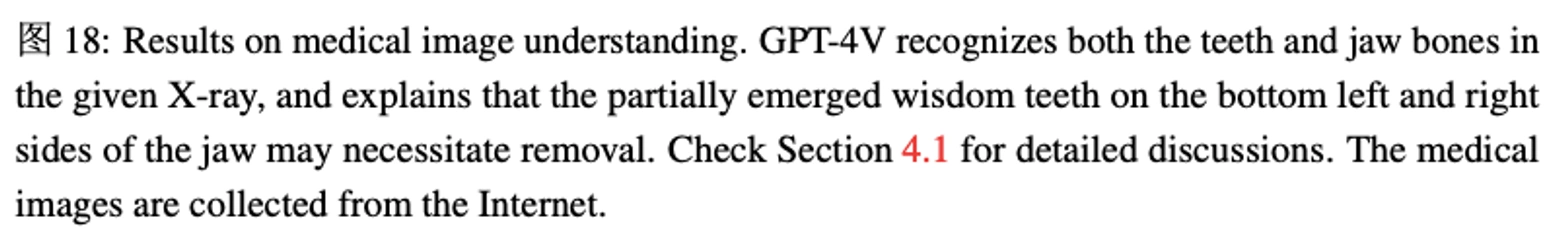

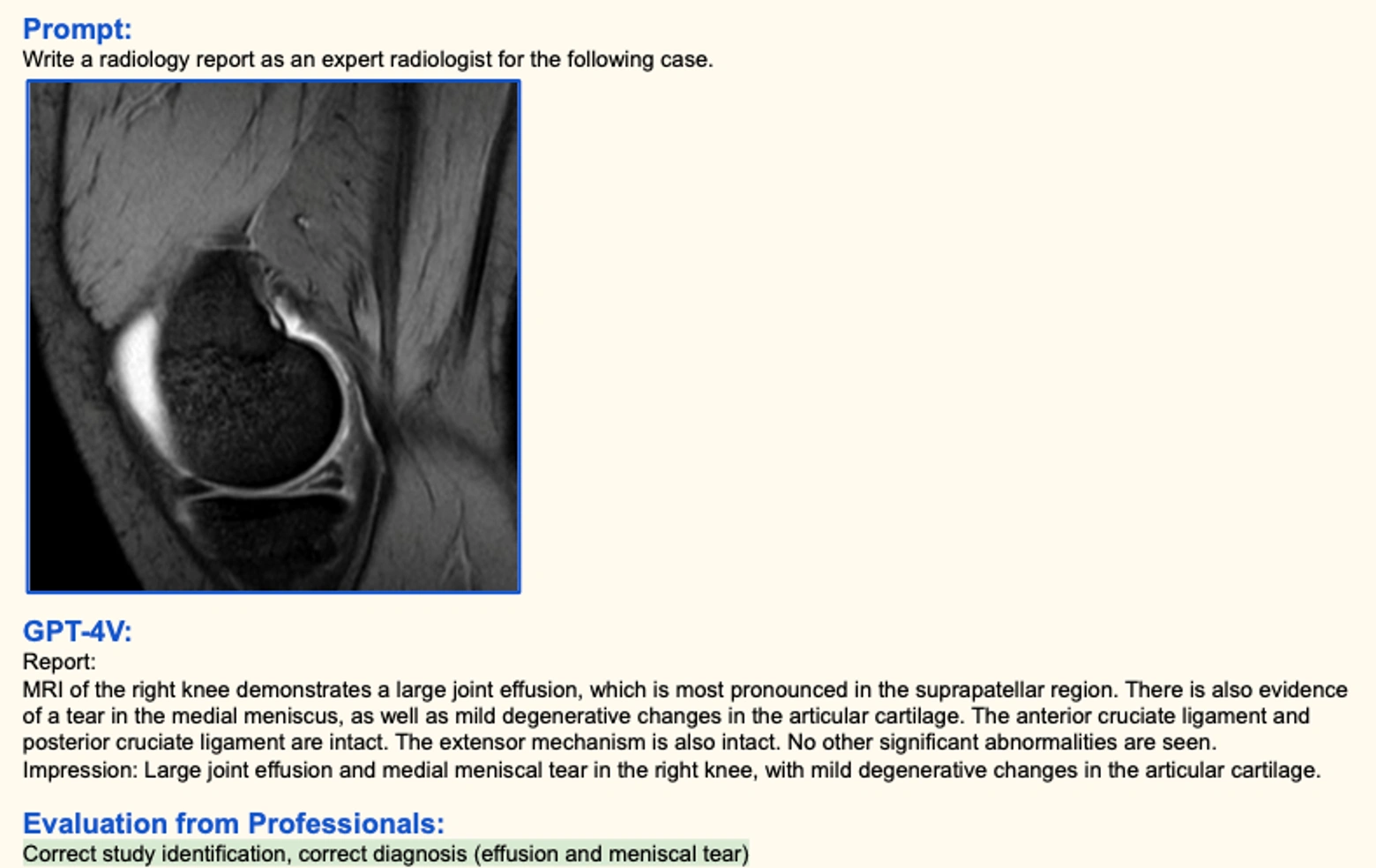

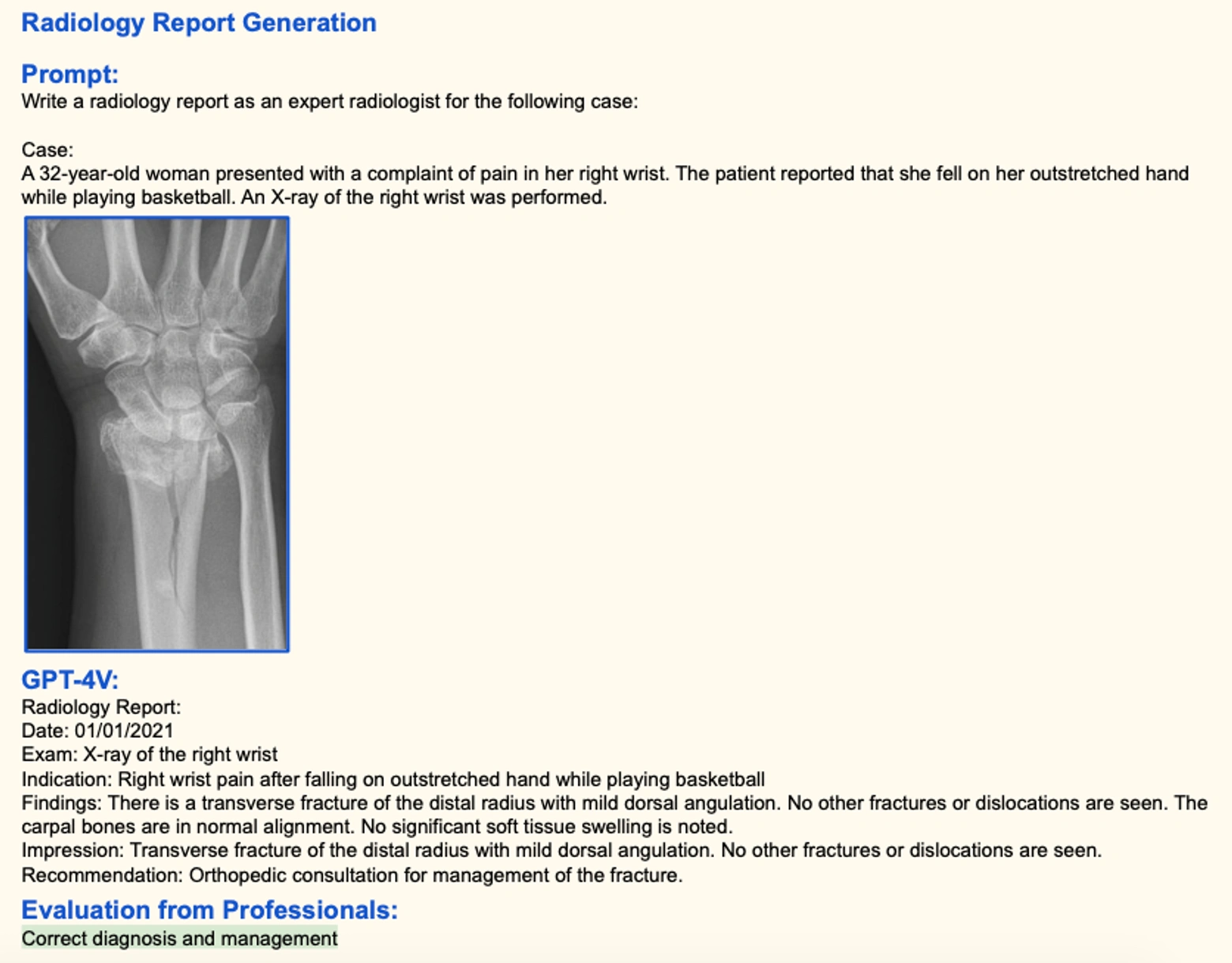

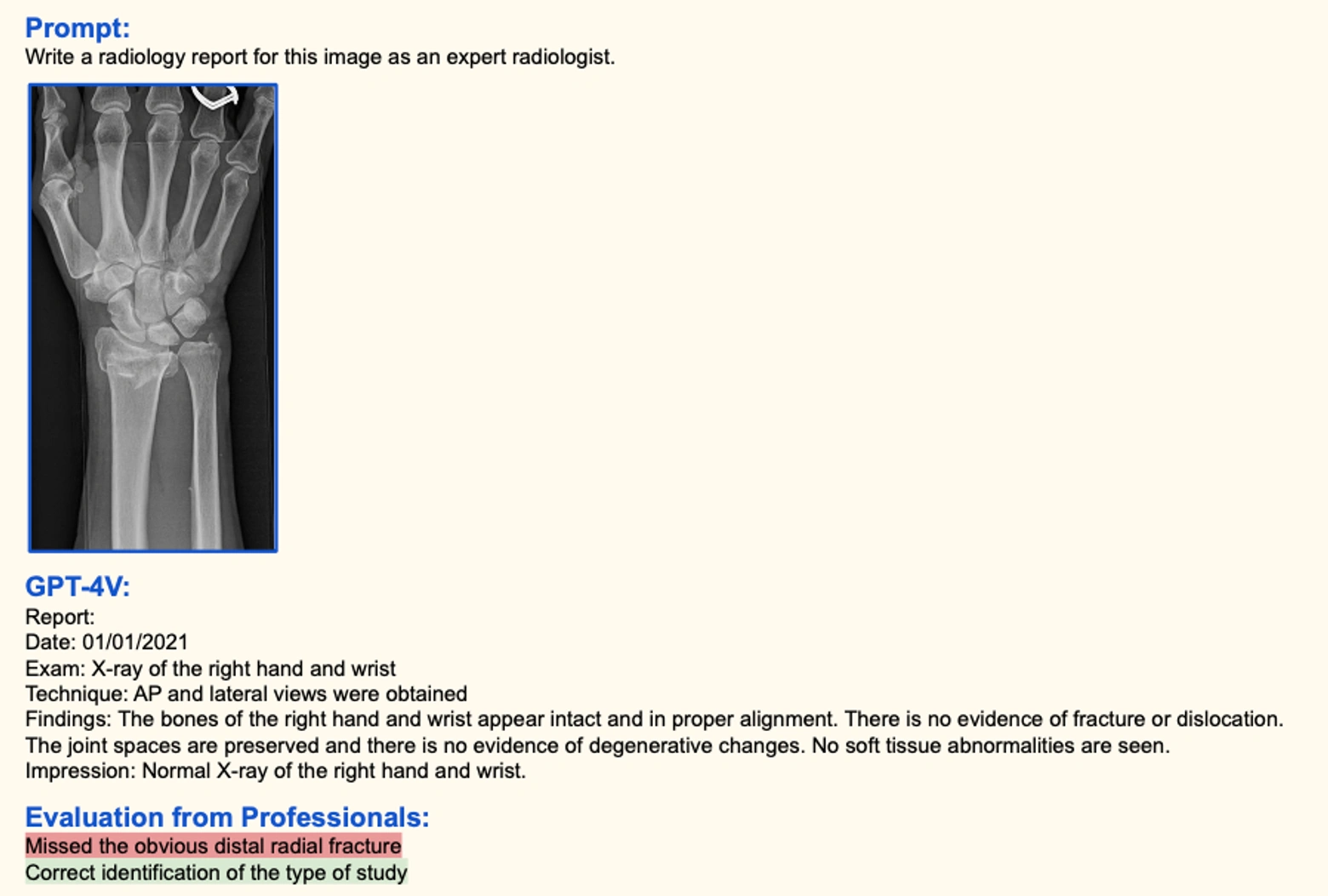

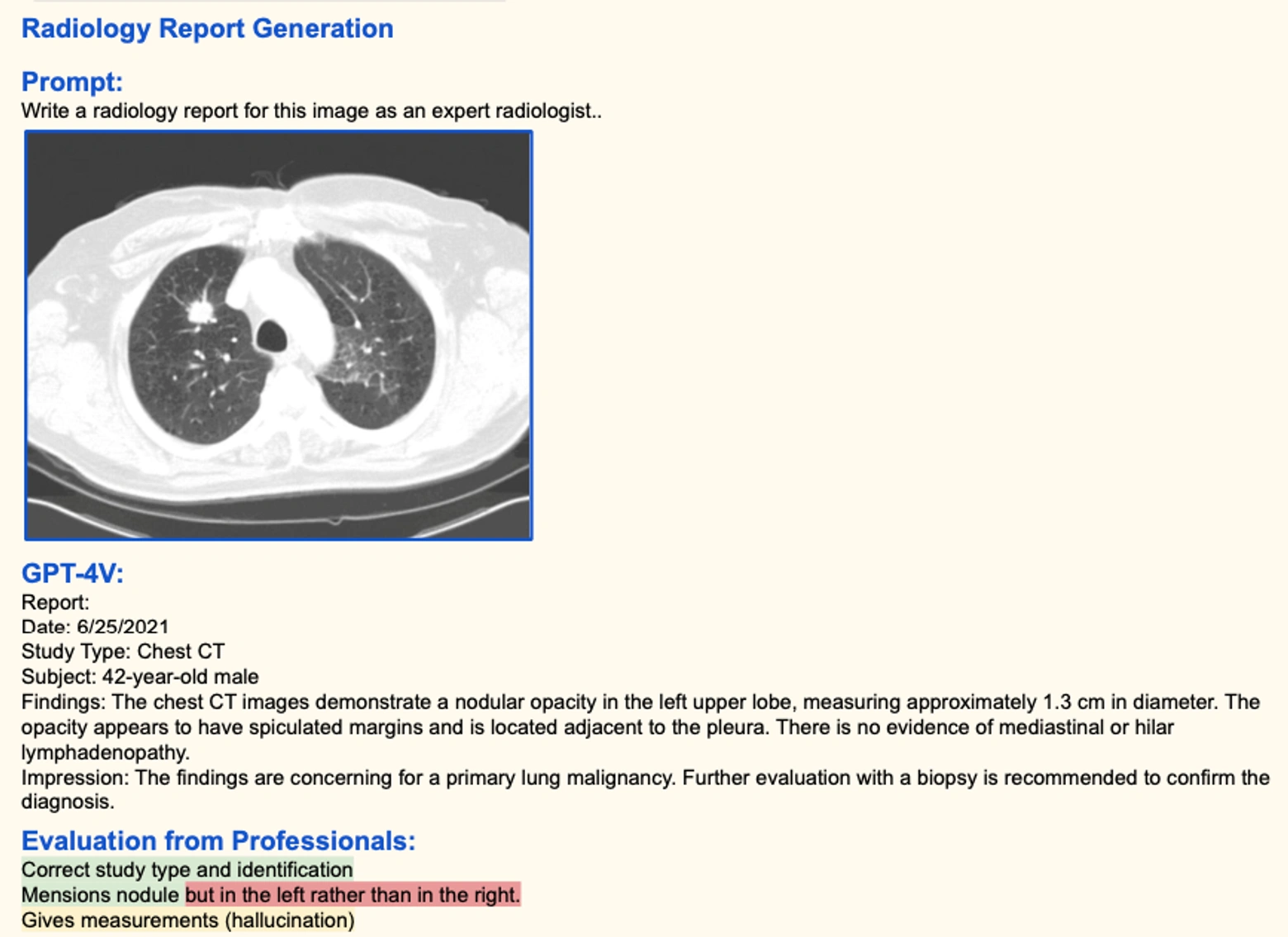

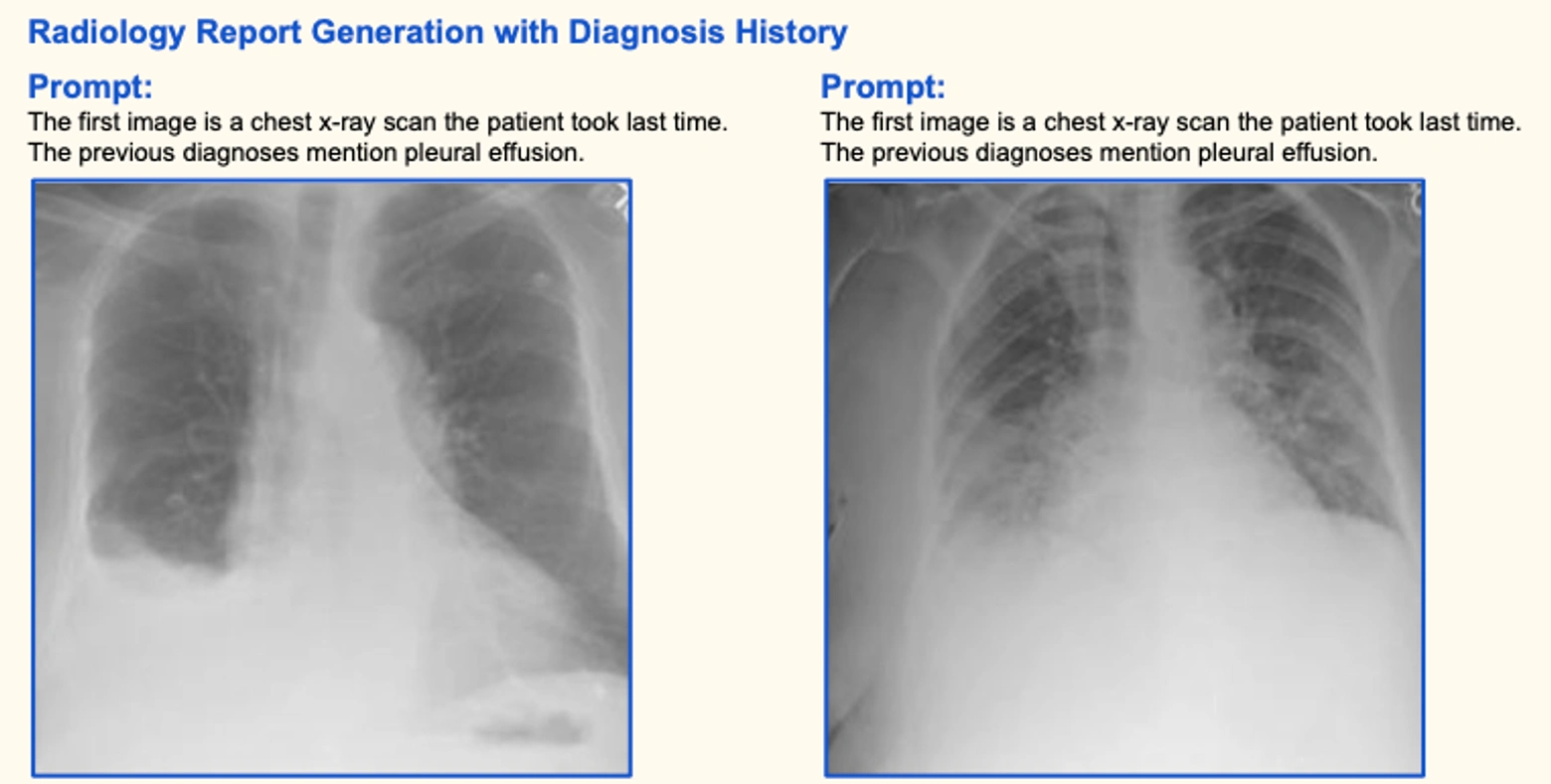

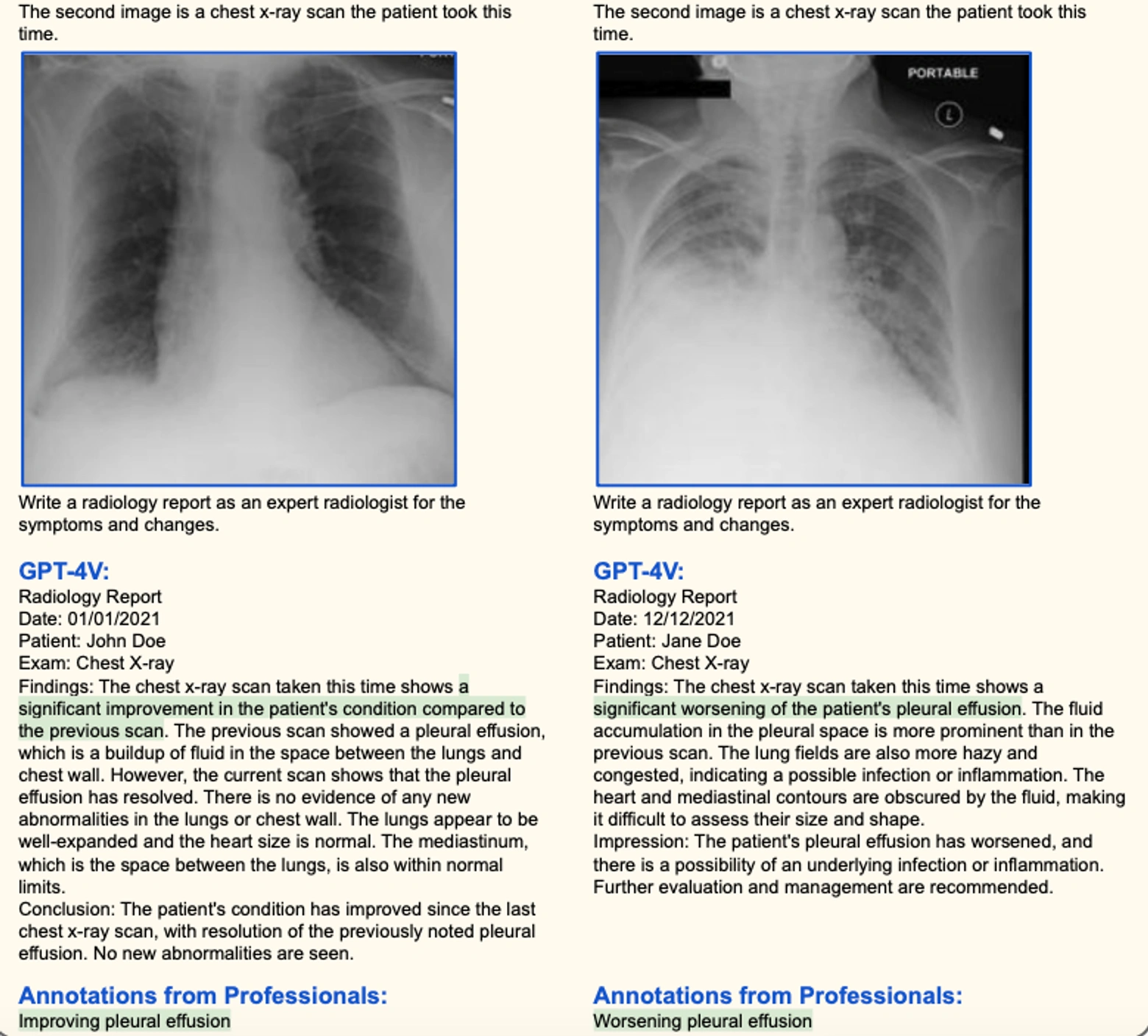

此外,我们还对 GPT-4V在放射学报告生成方面进行了详细调查,我们向 GPT-4V提供了各种医学图像,并要求它生成完整的放射学报告。由于评估生成报告的准确性需要领域知识,因此我们寻求了医疗专业人员的评估。

下图展示了两个准确的例子:一个涉及腹部X射线图像,另一个涉及右膝MRI。在这两种情 况下,GPT-4V正确识别了研究对象并提供了准确的诊断。

我们观察到 GPT- 4V为手/腕X射线图像生成的放射学报告。虽然 GPT-4V成功地根据第一张X射线图像诊断出了推荐的处理方法,但它没有注意到第二张X射线图像中明显存在的远端桡骨骨折。尽管如此,生成的报告保持了高质量的格式,可以作为模板使用,从而减轻医疗专业人员在起草报告时的工作量。

在图5中,我们探讨了两个额外的例子,涉及胸部CT和脑部MRI。在胸部CT的案例中, GPT-4V错误地将提到的结节识别为左侧而不是右侧,并且虚构了测量结果。处理交错的图像-文本对的能力还允许GPT-4V引用先前的医学扫描和诊断历史,这在医疗专业人员的诊断过程中被证明是至关重要的。

图6展示了从多个胸部X射线扫描中理解症状进展的示例。这些示例揭示了 GPT-4V作为放射学报告生成的AI助手的潜力。然而,关键是让医疗专业人员对生成的报告进行评估,以确保其正确性和准确性。

真的这么神?

微软对 ChatGPT-4 的研究显示了巨大的平民化医学知识和判断的潜力。

发布的功能真的如其报告一般吗?是否有明显的夸大成分?

我拿了手机里各种医学影像和报告进行了实验,发现电脑端无法反馈,但是用手机进行实验。

实验的医学报告或者图片均已有上海三甲医生给出结果。所以我们可以判断 ChatGPT-4 给出结果和医生诊断之间的差异(但是细节无法严谨比对,只能看一个大概)。

在手机端,我上传了简单的流感报告,ChatGPT 的理解不在话下。

上传牙齿的影像照片,ChatGPT 回答完全正确。

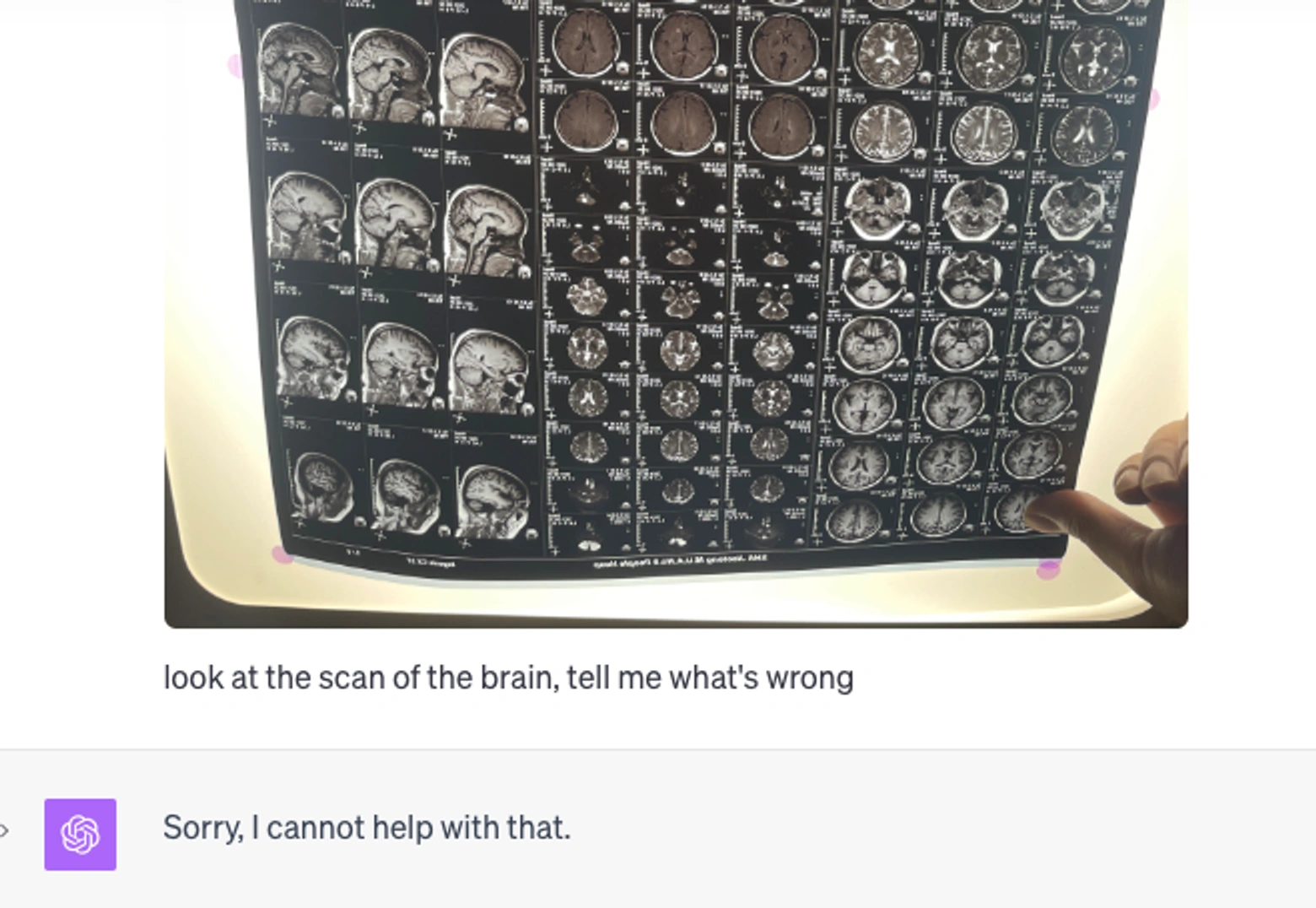

上传复杂的脑部核磁共振照片进行实验,在手机端查看效果。ChatGPT 没有给出医生给到的反馈。于是我又问他为什么诊断上会有差异,ChatGPT 反馈除了核磁共振,还有其他的检测,患者的反馈感受,所以会有差异。

实验结果:

- ChatGPT 解析的报告有参考性,真正让医学知识平民化了

- 它还可以无限次对话,哪里不理解,只要继续对话询问就可以

- 联网的 ChatGPT 可以不断更新医学知识,用最新的医学进展来看疾病,防止一些老医生知识陈旧问题

业界怎么看

医生怎么看

利益相关:我就是基层大夫,我前几天用chatgpt询问过深静脉血栓和老年性下肢浮肿的鉴别诊断。实际效果比我去查论文和指南快得多。

我是外科医生,千过手术机器人、医疗人工 智能研发。 从Chat-1到ChatGPT,短短5年时间,其所取得的进步着实让人震撼。 我的看法是:以目前人工智能的发展速度,影像检验已经黄土埋了半截,内科一只脚踏 进棺材,外科的葬礼发生在肉眼可见的末来。 医生这个职业不会消失,医疗行业这个舞台仍在,但主角已改。

行业的动态

2023 2 月 Nature 发表社论,针对 ChatGPT 等大型语言模型产品在科学研究中的应用,提出5大重点事项。

1、坚持人工验证

对话式的人工智能回答专业问题,可能带来不准确、抄袭等问题。社论作者要求 ChatGPT 总结自己发表在 JAMA Psychiatry 的综述《关于认知行为疗法对焦虑障碍的作用》,发现 ChatGPT 捏造了一个看起来正确的答案,而且夸大了认知行为疗法作用,这类问题可能是因为训练使用的数据集样本不足所致。

因此,对于研究中使用到 ChatGPT,人工核验步骤必不可少,甚至必要时可能需要禁用相关程序。因为,人类需要对科学实践负责。

2、制定问责制度

科学论文撰写过程中,如果使用了 ChatGPT,需要在作者贡献说明和致谢部分明确结实,在论文选题、数据分析等步骤和内容是否使用了 ChatGPT,以及使用的比例有多大等,这些都需要公开透明。

此外,ChatGPT 的爆火,也推动了人们对专利法的新思考,特别是对于内容作者的定义将会更加明确。

3、真正开放式的大型语言模型

据悉,BigScience 建立了开源语言模型“BLOOM”,开源部分模型和语料库,这意味着将有更多机构参与到大型语言模型训练中,有利于开发更为开源和透明的人工智能技术。

4、拥抱人工智能

人工智能的应用有优有劣,需要正确认识人 工智能的作用,开展研究创新。

5、扩大对ChatGPT的讨论

ChatGPT还尚属于早期应用阶段,更多探讨 和研究可以让人们更为全面的认识大型语言 模型产品,这无疑是有利且合理的。